En el panorama jurídico de 2026, ya no hablamos de la inteligencia artificial (IA) como una promesa de futuro o un guion de ciencia ficción.

La integración de sistemas de aprendizaje profundo en la toma de decisiones empresariales, diagnósticos médicos, conducción autónoma y gestión de contratos es una realidad cotidiana.

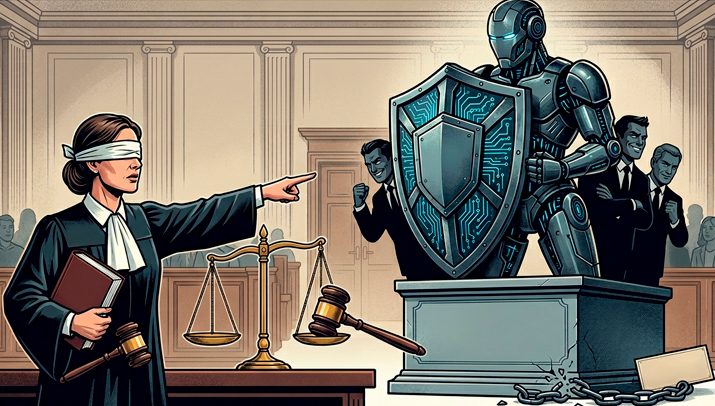

Sin embargo, esta adopción masiva ha traído consigo una pregunta que desafía los cimientos del derecho civil tradicional: ¡cuando un sistema autónomo causa un daño, a quién debemos demandar!

La complejidad de los algoritmos actuales, a menudo descritos como «cajas negras», dificulta la aplicación de la teoría clásica de la culpa.

Si un médico sigue la recomendación de una IA y el paciente sufre una lesión, o si un vehículo autónomo decide realizar una maniobra que resulta en un accidente, la cadena de causalidad se fragmenta.

¿Es culpa del programador, del propietario, del fabricante del hardware o de la propia máquina?

El nuevo paradigma de la responsabilidad objetiva en la era digital

Contenidos de interés en este artículo:

El derecho español y europeo ha tenido que evolucionar rápidamente para no dejar a las víctimas en un vacío legal. La tendencia actual se aleja de la necesidad de probar la «negligencia» humana en el código para centrarse en la responsabilidad objetiva por riesgo.

Según este principio, quien pone en funcionamiento una tecnología que genera un beneficio económico y, simultáneamente, un riesgo potencial para terceros, debe asumir las consecuencias de sus errores.

Este enfoque busca proteger al consumidor final. Para entender el marco normativo que sostiene estas decisiones, es imprescindible consultar el Reglamento de Inteligencia Artificial de la Unión Europea, que establece las obligaciones de transparencia y seguridad según el nivel de riesgo del sistema. No se espera que el usuario entienda cómo funciona la red neuronal del algoritmo, sino que se garantiza que exista un responsable financiero capaz de resarcir el daño causado.

El reto de la trazabilidad y la transparencia algorítmica

Uno de los mayores obstáculos procesales en 2026 es el deber de transparencia. Para que un abogado pueda defender los intereses de su cliente frente a un error algorítmico, debe tener acceso a la lógica que llevó a la máquina a tomar una decisión.

¡Aquí es donde la transparencia algorítmica juega un papel crucial! Las empresas ya no pueden escudarse en el «secreto comercial» cuando sus sistemas afectan a derechos fundamentales.

La justicia española exige que las empresas mantengan un control riguroso basado en tres pilares:

El papel de los seguros obligatorios en sistemas autónomos

Ante la incertidumbre, la solución jurídica más pragmática ha sido la implementación de seguros de responsabilidad civil específicos para IA. Al igual que sucede con los vehículos a motor, se está consolidando la obligatoriedad de que los desarrolladores y usuarios de sistemas autónomos cuenten con pólizas que cubran errores de procesamiento.

Esto simplifica el litigio de manera drástica. El perjudicado no necesita demostrar un error en las líneas de código (una tarea técnica hercúlea y costosa), sino simplemente acreditar el daño y el nexo causal entre la acción de la IA y el resultado negativo.

Es una victoria para la seguridad jurídica. La existencia de este «fondo de garantía» asegura que la innovación tecnológica no avance a costa de los derechos de los ciudadanos.

La personalidad jurídica de la inteligencia artificial: ¿Un debate cerrado?

Durante años se debatió si debíamos otorgar una «personalidad electrónica» a los robots más avanzados para que pudieran responder con su propio patrimonio.

A día de hoy, la doctrina mayoritaria y la jurisprudencia española han rechazado esta idea. Se considera que otorgar personalidad a la IA sería una forma de eximir de responsabilidad a los verdaderos beneficiarios económicos de la tecnología.

La IA sigue siendo, a ojos de la ley, una herramienta. Por muy sofisticada que sea, siempre hay un operador humano o una persona jurídica detrás.

Por lo tanto, la responsabilidad siempre debe ser rastreada hasta el sujeto que tiene el control del riesgo o que obtiene el lucro de su implementación.

¡No podemos permitir que las máquinas se conviertan en escudos legales para la irresponsabilidad humana!

El impacto en la práctica del derecho de daños

Para los abogados del siglo XXI, el peritaje informático se ha vuelto tan importante como el peritaje médico. Ganar un caso de responsabilidad civil hoy requiere entender la interacción entre el software y el entorno físico. La prueba pericial ya no solo analiza huellas físicas, sino flujos de datos y modelos de entrenamiento.

Estamos ante una transformación profunda del artículo 1902 del Código Civil. Aunque el texto permanece, su interpretación se ha expandido para cubrir realidades que el legislador de 1889 jamás pudo imaginar. La diligencia del «buen padre de familia» ahora se traduce en la diligencia del buen supervisor de sistemas, exigiendo:

En conclusión, la tecnología avanza a una velocidad vertiginosa, pero el derecho está demostrando una notable capacidad de adaptación.

La protección del individuo frente a la automatización es el gran reto jurídico de nuestra década

Como profesionales, nuestra labor es garantizar que, por muy inteligente que sea la máquina, la justicia siga siendo una balanza equilibrada por manos humanas. El futuro de la abogacía no es competir con la IA, sino convertirnos en los arquitectos de su regulación y en los defensores de quienes se ven afectados por sus fallos.